- El mayor peligro de la seguridad de la IA

- Industria de chips China.

- Juega en el mercado. Reddit

- TikTok ganó un extraño aliado en su lucha en Washington

- El Pentágono ha lanzado la iniciativa Replicator y más de 800 proyectos de IA están en marcha

Hola y bienvenido de nuevo a Semafor Tech.

Desde el lanzamiento de ChatGPT en noviembre de 2022, hemos estado cubriendo bastante de cerca el movimiento de seguridad de la IA. Seguimos la carta de “pausa” del Future of Life Institute, que pedía una pausa de seis meses en el desarrollo de la IA, antes de que fuera demasiado tarde para detener una amenaza a la humanidad.

Entrevisté al fundador de Skype, Jaan Tallinn, sobre su incapacidad para frenar lo que consideraba una peligrosa marcha hacia la superinteligencia.

En otras palabras, la seguridad de la IA consistía en que la IA no nos matara. Pero últimamente me he encontrado escribiendo sobre ello para describir mucho más que simplemente seguridad en el sentido literal de la palabra. Y ese viaje de vocabulario ha estado en mi mente.

Lo que no me di cuenta es que esto no es un accidente. Hay un debate en la industria de la IA y entre quienes esperan controlarlo de varias maneras. El impulso es incluir más temas en el grupo de “seguridad”, utilizando el término como un todo para cualquier posible impacto de la IA.

Pero se está gestando un retroceso. Algunas cuestiones de la IA, como la moderación de contenidos, son intrínsecamente políticas. Basta con mirar lo que pasó con el chatbot y el generador de imágenes Gemini de Google en las últimas semanas. Existe la preocupación de que la política pueda distraer o erosionar cuestiones no políticas de la IA. Lea abajo para más detalles.

Y estoy en camino a SXSW y estaré atento a todo lo relacionado con la IA mientras esté allí. Déjame saber si tienes algún consejo.

Mover rápido/romper cosas

➚ MOVERSE RÁPIDO : Pueden jugar dos. China está recaudando 27.000 millones de dólares para canalizarlos hacia su industria de chips, cifra que superará su último fondo. A medida que se intensifica la competencia tecnológica, Estados Unidos finalmente está repartiendo los 50 mil millones de dólares que reservó para impulsar la fabricación nacional de semiconductores. Pero China todavía está a la cabeza en inversión gubernamental, y su último esfuerzo marca su tercer fondo.

➘ ROMPER COSAS : Juega en el mercado. Reddit iniciará su gira la próxima semana antes de su salida a bolsa a finales de este mes. El rango de precios informado por el Financial Times sitúa su valoración en alrededor de 6.500 millones de dólares, en comparación con los 10.000 millones de dólares de 2021. En general, los mercados de OPI han estado agitados y los propios problemas de Reddit, desde boicots hasta controversias de contenido, significan que está haciendo una gran apuesta.

Reed Albergotti

¿Qué debería significar «seguridad de la IA»?

LA ESCENA

El concepto de “seguridad de la IA” se ha ido ampliando para incluir todo, desde la amenaza de extinción humana hasta el sesgo algorítmico y la preocupación de que los generadores de imágenes de IA no sean diversos.

El investigador Eliezer Yudkowsky, que ha estado advirtiendo sobre los riesgos de la IA durante más de una década en podcasts y otros lugares, cree que agrupar todas esas preocupaciones en un solo cubo es una mala idea. «Se quieren nombres diferentes para el proyecto de ‘hacer que las IA no maten a todos’ y ‘hacer que las IA utilizadas por los bancos otorguen préstamos justos», dijo. «Ampliar las definiciones suele ser una tontería, porque normalmente es más prudente pensar en diferentes problemas de manera diferente, y el riesgo de extinción de la IA y el riesgo de sesgo de la IA son riesgos diferentes».

Yudkowsky, una figura influyente pero controvertida por sus opiniones alarmistas sobre la IA (escribió en Time sobre la posible necesidad de ordenar ataques aéreos contra centros de datos de IA), no está solo en sus opiniones. A otros en la industria de la IA les preocupa que la “seguridad” en la IA, que ha llegado a apuntalar las barreras que las empresas están implementando, pueda politizarse a medida que crezca para incluir temas sociales candentes como los prejuicios y la diversidad. Eso podría erosionar su significado y poder, incluso cuando recibe enormes inversiones públicas y privadas y una atención sin precedentes.

«Es mejor ser más preciso acerca de las preocupaciones que uno tiene», dijo Anthony Aguirre, director ejecutivo del Future of Life Institute, que durante mucho tiempo se ha centrado en los riesgos existenciales que plantea la IA. “Si estás hablando de deepfakes, habla de deepfakes. Y si estás hablando del riesgo de los modelos básicos de código abierto, habla de eso. Supongo que tal vez estemos en la máxima cobertura de seguridad antes de comenzar a usar otros adjetivos”.

Qué debería incluirse exactamente bajo el paraguas de seguridad de la IA fue el tema de una mesa redonda el martes en el Comité Asesor Nacional de Inteligencia Artificial, que está formado por ejecutivos de empresas, académicos y otras personas que asesoran a la Casa Blanca.

Un asistente dijo a Semafor que la reunión reforzó el creciente énfasis en la industria en asegurarse de que el término abarque una gama más amplia de daños que solo amenazas físicas.

Pero el asistente dijo que una preocupación con la definición ampliada es que agrupa conceptos inherentemente políticos como la moderación de contenido con cuestiones no políticas como la mitigación del riesgo de armas biológicas. El riesgo es que la seguridad de la IA se convierta en sinónimo de lo que los conservadores ven como “IA despierta”.

Durante la mayor parte de la última década, el término “seguridad de la IA” fue utilizado coloquialmente por un pequeño grupo de personas preocupadas por los riesgos catastróficos y en gran medida teóricos de la inteligencia artificial. Y hasta hace poco, las personas que trabajaban en otros campos se centraban en cuestiones como el sesgo algorítmico y la vigilancia y se consideraban trabajando en campos completamente separados.

Ahora, a medida que los productos de IA generativa como ChatGPT han puesto la tecnología a la vanguardia de todas las industrias, la seguridad de la IA se está convirtiendo en un término general que agrupa casi todas las posibles desventajas de la automatización del software en un solo grupo lingüístico. Y decisiones como qué etnias deben incluir los generadores de imágenes de IA se consideran parte de la seguridad de la IA.

La agencia gubernamental recién creada, el AI Safety Institute , por ejemplo, incluye en su mandato todo, desde armas nucleares hasta privacidad y habilidades laborales. Y Google recientemente incorporó el 90% de un grupo de ética de IA, llamado Equipo de Innovación Responsable, a su equipo de Confianza y Seguridad, dijo un portavoz de la compañía a Wired .

Mike Solana, vicepresidente de Founders Fund y autor del boletín Pirate Wires, es un crítico frecuente de las políticas de moderación de contenidos de las grandes empresas tecnológicas.

«La confusión intencionada de términos aquí es totalmente absurda», afirmó. “Obviamente hay una diferencia entre mitigar el riesgo existencial para la civilización humana y la cuestión de si hay suficientes mujeres musulmanas con velos apareciendo cuando se intenta generar una imagen de un mecánico de automóviles. Pero esa confusión de términos beneficia a las personas obsesionadas con el tema DEI, y son muy buenos para navegar en la burocracia, así que aquí estamos”.

La opinión de Reed sobre por qué la IA tiene un problema de vocabulario de larga data. →

Watchdogs

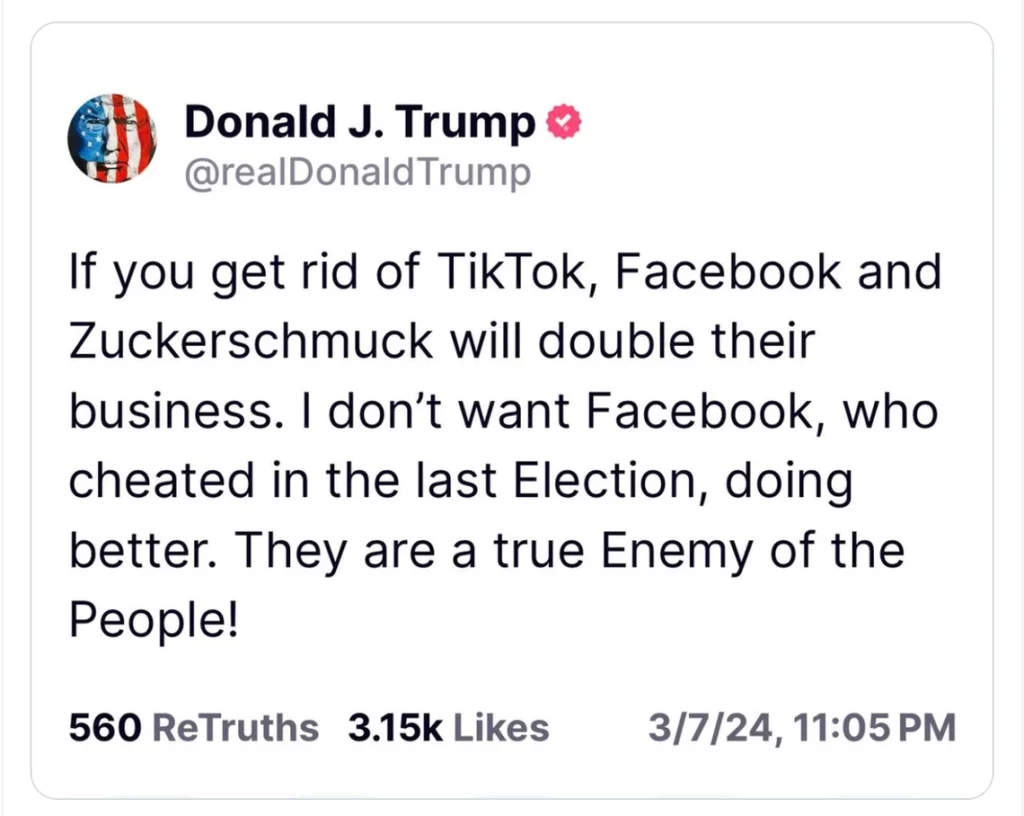

TikTok ganó un extraño aliado en su lucha en Washington. A través de su aplicación, la empresa instó a los usuarios a ponerse en contacto con su miembro del Congreso para expresar su oposición a un plan que obligaría a la empresa matriz ByteDance a deshacerse de TikTok o el servicio podría ser prohibido en las tiendas de aplicaciones.

Los partidarios del proyecto de ley lo llamaron una campaña de intimidación después de que las oficinas de los representantes se vieron inundadas de llamadas. El plan terminó siendo aprobado por el Comité de Energía y Comercio de la Cámara de Representantes en una inusual votación de 50-0. Ahora está en camino rápido hacia el pleno de la Cámara de los Estados Unidos para una votación la próxima semana.

Entra Donald Trump. El expresidente también intentó prohibir TikTok y fracasó. Pero anoche dijo que si el Congreso toma una medida similar, Facebook y “Zuckerschmuck” duplicarán su negocio. Pero nuestros colegas principales informan que los republicanos están avanzando , desafiando a su presunto candidato presidencial.

Lo que estamos rastreando

Después de años en los que Silicon Valley despreció con orgullo al ejército estadounidense, la revolución de la tecnología de defensa ha llegado con toda su fuerza. En Medio Oriente, la IA se está utilizando para identificar objetivos para ataques aéreos, el Pentágono ha lanzado la iniciativa Replicator en un intento por adquirir miles de drones autónomos y baratos, y más de 800 proyectos de IA están en marcha dentro del ejército estadounidense.

También tendrá una gran presencia en SXSW, con docenas de funcionarios de defensa trabajando con su departamento.

«Muchos altos responsables de la toma de decisiones han dicho que es importante para nosotros tener gente en el terreno hablando con capitalistas de riesgo, hablando con nuevas empresas», dijo el teniente Gray Chynoweth, subdirector de estrategia y participación en el centro de innovación de la Marina, NavalX. «No queremos estar aquí sólo para comer barbacoa».

La Armada traerá su mayor presencia al festival, dijo Chynoweth a Semafor, y recibirá a altos funcionarios de la firma de capital de riesgo In-Q-Tel respaldada por la CIA, la agencia de investigación y desarrollo del Pentágono, DARPA, y la Unidad de Innovación de Defensa.

La lista de deseos de la Armada en SXSW son capacidades para una Internet de las cosas marítima, vehículos submarinos y de superficie no tripulados y software de inteligencia artificial para procesar el torrente de datos que la Armada está recopilando. «Podemos presentar estos problemas a todas estas brillantes empresas emergentes que buscan una manera de hacer lo que les encanta hacer, que es resolver problemas para los usuarios», dijo Chynoweth.

«Lo que encontrará de manera uniforme en todo el ecosistema de innovación del Departamento de Defensa es que estamos entusiasmados con las empresas», dijo Chynoweth. «Eso es lo que nos despertará temprano, eso es lo que nos mantendrá despiertos hasta tarde».

— Mathías Martillo

Caliente en Semafor

- «Cómo el ‘Proyecto 2025’ se convirtió en el objetivo favorito de la campaña de Biden «.

- Por qué la guerra de Sudán podría desencadenar » la mayor crisis de hambre del mundo» .

- Un banco neoyorquino que se tambalea ha sido rescatado. ¿Será el último ?